에러 = 실제값 - 예측값

MSE = 에러의 제곱들의 평균을 손실함수로 적용할 수 있음

하지만 원래 예측하고자 하는 대상의 제곱으로 표현되기 떄문에 해석이 깔끔하지 않음

그 때문에 루트를 씌워서 루트를 사용함

RMSE의 값이 클수록 예측의 퀄리티다 떨어진다는 것을 의미하므로 RMSE를 줄여나가야 함

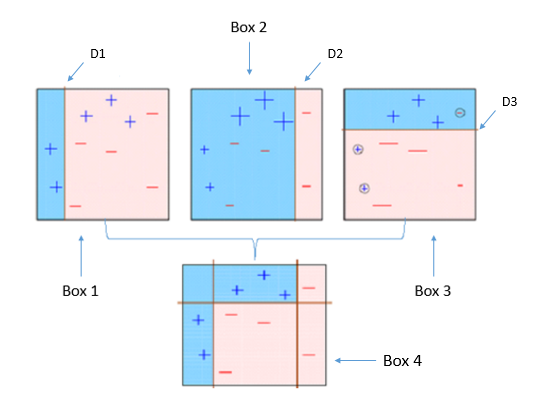

위의 예시에서도 좌측의 RMSE가 더 낮으므로 더 좋은 모델이라고 할 수 있음

하지만 RMSE는 분류문제에서는 잘 작동하지 않음

레이블이 1일 때 예측을 0, 레이블이 0일 때 예측을 1 이라고 할 때

이 두 경우 모두 RMSE를 적용하면 같은 정도의 패널티를 가짐

예측 결과가 나쁠 수록 패널티가 더 부과되어야 하는데 RMSE에서는 큰 차이가 생기지 않음

따라서 분류 문제에서는 Cross Entropy(Log Loss) 개념을 사용함

이 방식은 레이블과 예측의 결과가 다를수록 더 큰 패널티가 생기는 함수

위의 예시에서 볼 수 있는 것처럼 예측을 잘 한 경우에는 손실 값이 낮지만

예측이 틀렸을 경우에는 하나만 잘못 되었다 하더라도 손실 값이 크게 늘어남

'구글 머신러닝 스터디잼(중급) > Launching into Machine Learning' 카테고리의 다른 글

| Optimization 1 : Defining ML Models (0) | 2019.10.21 |

|---|---|

| ML History 7 : Modern Neural Networks (0) | 2019.10.21 |

| ML History 6 : Random Forests (0) | 2019.10.21 |

| ML History 5 : Kernel Methods (0) | 2019.10.21 |

| ML History 4 : Decision Tree (0) | 2019.10.20 |